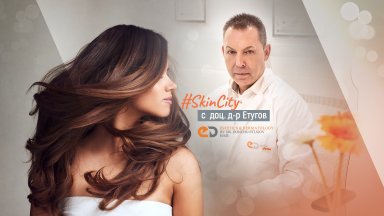

Изкуствен интелект създава "истински" снимки на "фалшиви" хора

Софтуерът на Nvidia би могъл да е доста опасен

Nvidia инвестира изключително много в своя изкуствен интелект, а последното му постижение показва, че парите не са били дадени напразно. Специално обучена двойна невронна мрежа е в състояние да генерира лица на хора, които не съществуват, но изглеждат неразличими от истинските.

Изкуственият интелект може да създава "фалшиви хора" от всякакъв пол, раса и възраст. Изображенията, генерирани от двойната невронна мрежа, са неотличими от снимки на истински хора и за това си има обяснение - изкуственият интелект е бил обучен, като е бил зареден с множество фотоси на реални хора. След като той е изучил чертите им, софтуерът се е научил да "смесва" няколко човека в един, а след това да създава и произволни личности.

Експерти заявяват, че ако софтуерът на Nvidia попадне в неподходящите ръце, той би могъл да е много опасен. Подобни снимки на несъществуващи хора могат да се използват за провокации, за по-реални ботове и за манипулация на общественото мнение.

Научният труд зад проекта на Nvidia е публикуван в arxiv.org.