Първо престъпление с използване на изкуствен интелект

Измамник е имитирал лицето на шефа на енергийна компания, за да присвои 243 000 долара

Технологията deep fake отдавна притеснява експерти по сигурността и дори политици с възможната си злонамерена употреба. Припомняме, че тя представлява използване на изкуствен интелект с цел имитация на реч от дадено лице, при което дори видимо изглежда, че то казва съответните думи.

По този начин може да се създаде изключително правдоподобно видео, в което на практика всеки човек може "да каже" неща, които реално никога не би изрекъл. Дори президентите на САЩ или Русия не са застраховани от подобна имитация чрез напредъка на технологиите.

А само преди ден от Великобритания дойде информация, че за първи път deep fake технология е използвана за кражбата на финансови средства от частна компания.

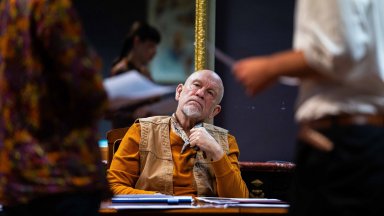

Неизвестни лица са имитирали видео с участието на главния изпълнителен директор на британска енергийна компания, чрез което са успели да присвоят сумата от 243 000 долара. Служителите на дружеството са останали с впечатление, че говорят с реалния шеф и са превели парите, без да се замислят.

Случаят разкрива тревожна картина на бъдещето, в което не можем да имаме доверие на никого и дори видео разговор с наш колега, шеф или приятел може да се окаже подозрителен.